Destination denna vecka meddelat en ny modell för artificiell intelligens (AI) öppet källa länka flera datatyper inklusive text, ljud, visuell data, temperatur och rörelseavläsningar. Modellen är bara ett forskningsprojekt för tillfället, utan omedelbara praktiska eller konsumenttillämpningar. Det pekar dock på en framtid av system generativ artificiell intelligens som kan skapa uppslukande upplevelser och multisensoriska. Hans namn är Meta ImageBind och vi förklarar hur det fungerar.

Meta introducerar ImageBind en ny multisensorisk AI-modell med öppen källkod. Så här fungerar det och vad det kan göra

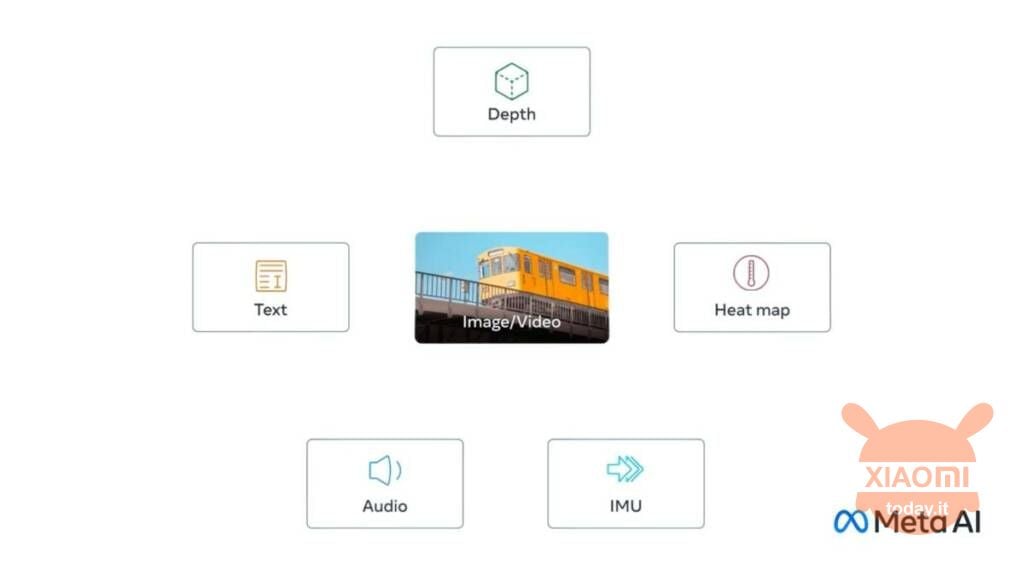

Nyheten heter Meta ImageBind och är den första att kombinera sex typer av data till ett enda flerdimensionellt utrymme. De sex datatyperna som ingår i modellen är:

- Visuals (i form av bilder och videor)

- Termisk (infraröd avbildning)

- testet

- Audio

- Fördjupad information

- Rörelseavläsningar genererade av en tröghetsmätenhet, eller IMU

Läs också: Meta introducerar SAM, AI som identifierar enskilda element i bilder

Tanken är att framtida AI-system kan göra korsreferera dessa uppgifter på samma sätt som nuvarande system gör för textinmatning. Föreställ dig till exempel en futuristisk virtuell verklighetsenhet som genererar inte bara ljud och visuella input, utan också vår miljö och vår rörelse på en fysisk scen. Användaren kan be verktyget att göra det efterlikna en lång sjöresa, och skulle inte bara sätta honom på ett skepp med vågornas brus i bakgrunden, utan också det vajande däcket under fötterna och den svala brisen från havsluften. Tanken är att plattformen kombinerar olika dataformat för att generera resultatet.

I ett blogginlägg noterar Meta det andra sensoriska inputströmmar kan läggas till till framtida modeller, inklusive "beröring, tal, lukt och fMRI hjärnsignaler". Den här nysläppta funktionen är inte klar än, så communityn kan inte testa den i detta tidiga skede, även om den är i ett avancerat utvecklingsstadium.